Introduction to AI and Machine Learning Basics

[C++ Basic] STL Data Structure

基础杂项

auto的使用

- 当你想要拷贝range的元素时,使用

for(auto x : range). - 当你想要修改range的元素时,使用

for(auto && x : range) - 当你想要只读range的元素时,使用

for(const auto & x : range).

容器间的转换

使用begin end

1 | vector<int>& nums1 |

以下是整理和改正后的迭代器笔记。

迭代器知识

随机访问迭代器

定义:随机访问迭代器是一种迭代器类型,允许在常数时间内访问序列中的任何元素,并支持灵活的迭代器操作。

运算支持:

- 支持指针算术运算,如

+和-运算符,允许轻松地在迭代器位置上进行移动。 - 支持下标运算符

[],使其用法与指针类似。 - 例如,对于一个指向数组的随机访问迭代器

it,可以通过*(it + i)或it[i]语法访问第i个元素。

- 支持指针算术运算,如

使用场景:

- STL 容器:

vector和deque都提供随机访问迭代器。 - 算法:一些标准库算法(例如

std::sort、std::nth_element)要求输入的迭代器必须是随机访问迭代器,以便快速定位和排序。

- STL 容器:

正向迭代器与反向迭代器

概述:在 C++ 中,容器一般提供正向迭代器(

begin()到end())和反向迭代器(rbegin()到rend()),二者在遍历方向上相反。转换:正向迭代器和反向迭代器可以相互转换,但类型不同,需要显式转换。

正向迭代器到反向迭代器:可以将一个正向迭代器转换为反向迭代器。

1

2Iterator it; // 假设 it 是正向迭代器

std::reverse_iterator<Iterator> rit(it); // 将 it 转换为反向迭代器 rit反向迭代器到正向迭代器:反向迭代器的

base()成员函数可以返回一个指向反向迭代器当前元素的下一个位置的正向迭代器。1

2std::reverse_iterator<Iterator> rit;

Iterator it = rit.base(); // 转换为正向迭代器,指向 rit 所指位置的后一个元素

注意:

- 反向迭代器

rit.base()指向的并不是rit当前元素本身,而是rit指向元素的下一个位置。

- 反向迭代器

反向遍历

C++ 提供了 rbegin() 和 rend() 来支持容器的反向遍历:

rbegin()返回一个反向迭代器,指向容器的最后一个元素。rend()返回一个反向迭代器,指向容器反向遍历时的“结束位置”,即第一个元素之前的一个位置。- 在循环中,注意使用

++it而非--it,因为反向迭代器的递增操作相当于在正向迭代器上进行递减操作。

1 | for (auto it = collection.rbegin(); it != collection.rend(); ++it) { |

前后第k个元素

std::prev函数接受两个参数:一个是指向迭代器的参数,另一个是整数偏移量。它返回从指定迭代器开始向前移动指定偏移量后的迭代器。std::next函数接受两个参数:一个是指向迭代器的参数,另一个是整数偏移量。它返回从指定迭代器开始向后移动指定偏移量后的迭代器。

1 | auto prevIt = std::prev(it); |

bitset

bitset类型存储二进制数位。

初始化

1 | std::bitset<16> foo; |

格式转换

将数转化为其二进制的字符串表示

1 | int i = 3; |

pair

1 |

|

tuple

1 |

|

char 与 字符串

元音与index的相互映射

1 | string vowel = "AEIOUaeiou"; |

string

初始化与读取

1 | std::string s0 ("Initial string"); |

读取空格分割的

1 | stringstream txt(s); |

增

删

改

查

顺序容器与关联容器

顺序容器包括vector、deque、list、forward_list、array、string,

- 支持快速顺序访问元素。

关联容器包括set、map,

- 支持高效的关键字查找和访问。

- 不支持顺序容器的位置相关的操作。原因是关联容器中元素是根据关键字存储的,这些操作对关联容器没有意义。

- 也不支持构造函数或插入操作这些接受一个元素值和一个数量值得操作。

关联容器和顺序容器有着根本的不同:关联容器中的元素是按关键字来保存和访问的。与之相对,顺序容器中的元素是按它们在容器中的位置来顺序保存和访问的。

二叉树

存储方式

链表,或者数组(如果父节点的数组下标是 i,那么它的左孩子就是 i * 2 + 1,右孩子就是 i * 2 + 2。)

链式结构如下,注意左右孩子节点

1 | struct TreeNode { |

遍历方式

深度遍历: 前/中/后序遍历。

注意:这里前中后,其实指的就是中间节点/根节点的遍历顺序

heap 堆

堆(Heap)是计算机科学中一类特殊的数据结构的统称。

堆通常是一个可以被看做一棵完全二叉树的数组对象。

堆满足下列性质:

堆中某个节点的值总是不大于或不小于其父节点的值。

- 大顶堆:每个结点的值都大于或等于其左右孩子结点的值;

- 小顶堆:每个结点的值都小于或等于其左右孩子结点的值。

堆总是一棵完全二叉树。

make_heap()将区间内的元素转化为heap.push_heap()对heap增加一个元素.pop_heap()对heap取出下一个元素.sort_heap()对heap转化为一个已排序群集.

1 |

|

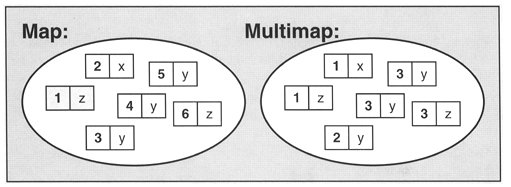

map / unordered_map / hash_map

- map

- 内部数据的组织,基于红黑树实现,红黑树具有自动排序的功能,因此map内部所有的数据,在任何时候,都是有序的。其中每个键都是唯一的,可以插入或删除,但不能更改。但是与键关联的值可以更改。

- 红黑树是一种含有红黑结点并能自平衡的二叉查找/搜索树, 别称平衡二叉B树(symmetric binary B-trees)

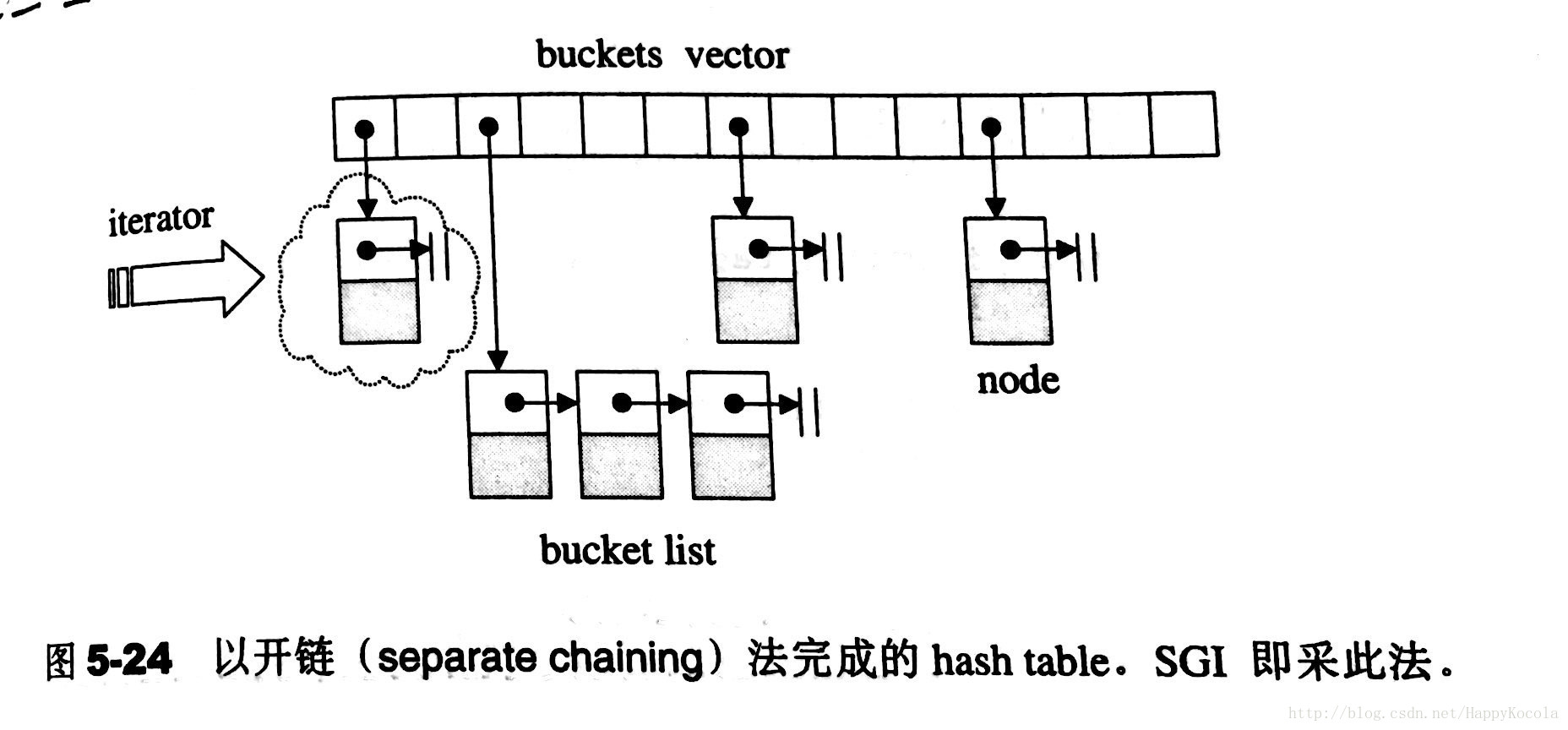

- unordered_map(hash_map)

- 基于哈希表,数据插入和查找的时间复杂度很低,几乎是常数时间,而代价是消耗比较多的内存。底层实现上,使用一个下标范围比较大的数组来存储元素,形成很多的桶,利用hash函数对key进行映射到不同区域进行保存。

- 标准库的unordered_map,底层实现是基于hashtable的,其避免冲突的方法是使用开链(seperate chaining)法,这种做法是在每一个表格元素中维护一个list,每个表格元素称之为buket(桶)

| 特性 | map | unordered_map |

|---|---|---|

| 元素排序 | 严格弱序 | 无 |

| 常见实现 | 平衡树或红黑树 | 哈希表 |

| 查找时间 | O(log(n)) | 平均 O(1),最坏 O(n)(哈希冲突) |

| 插入时间 | O(log(n)) + 重新平衡 | 同查找时间 |

| 删除时间 | O(log(n)) + 重新平衡 | 同查找时间 |

| 需要比较器 | 只需 < 运算符 |

只需 == 运算符 |

| 需要哈希函数 | 不需要 | 需要 |

| 常见用例 | 当无法提供良好哈希函数或哈希 | 在大多数其他情况下。当顺序不重要时 |

| 函数太慢,或者需要有序时 |

初始化

map的value是int,默认为0。可以直接++

1 |

|

增改

1 | // insert 不能覆盖元素,已经存在会失败 |

删除

1 | mymap.erase ('c'); // erasing by key |

查

1 | //unordered_map 类模板中,还提供有 at() 成员方法,和使用 [ ] 运算符一样,at() 成员方法也需要根据指定的键,才能从容器中找到该键对应的值; |

set

常用于 一个值是否存在 的相关问题

- 按关键字有序:

set(关键字即值,即只保存关键字的容器);使用红黑树,自动排序,关键字唯一。multiset(关键字可重复出现的set);

- 无序集合:

unordered_set(用哈希函数组织的set);unordered_multiset(哈希组织的set,关键字可以重复出现)。

set/map 的有序性

默认红黑树,使用std::less 作为比较器, 升序序列。

| 存放数据类型 | 排序规则 |

|---|---|

| 整数、浮点数等 | 按从小到大的顺序排列 |

| 字符串 | 按字母表顺序排列 |

| 指针 | 按地址升序排列 |

| 指向某元素的指针 | 按指针地址递增的顺序排列 |

| 类(自定义) | 可以自定义排序规则 |

1 | // 自定义比较器,按降序排列 |

增删改查

1 | //增改 |

并差集

- 并查集主要用于处理一些不相交集合的合并和查询问题。它在很多算法问题中都有广泛的应用,特别是在图论和动态连通性问题中。

并查集的基本操作

- 初始化

UnionFind(int n):每个元素初始化为自己的父节点。 - 查找

int find(int x):查找某个元素的根节点,并进行路径压缩以优化后续查找。 - 合并

int find(int x):将两个元素所在的集合合并为一个集合。

核心是

- 同一个并查集内的元素会指向同一个parent

- 维护并查集深度Rank,来按秩合并。

- 数据结构用数组和map都行

容器适配器

C++ 中的容器适配器 stack、queue 和 priority_queue 依赖不同的基础容器来实现特定的数据结构行为。每种容器适配器都有特定的成员函数要求,默认选择的基础容器是为了更好地满足这些要求。

| 容器适配器 | 基础容器筛选条件 | 默认使用的基础容器 |

|---|---|---|

| stack | 基础容器需包含以下成员函数: | deque |

- empty() |

||

- size() |

||

- back() |

||

- push_back() |

||

- pop_back() |

||

满足条件的基础容器有 vector、deque、list。 |

||

| queue | 基础容器需包含以下成员函数: | deque |

- empty() |

||

- size() |

||

- front() |

||

- back() |

||

- push_back() |

||

- pop_front() |

||

满足条件的基础容器有 deque、list。 |

||

| priority_queue | 基础容器需包含以下成员函数: | vector |

- empty() |

||

- size() |

||

- front() |

||

- push_back() |

||

- pop_back() |

||

满足条件的基础容器有 vector、deque。 |

stack 栈

堆栈,先进先出

1 | stack<int> minStack; |

注意pop仅用于从堆栈中删除元素,并且没有返回值, 一般用法如下

1 | top_value = stIn.top(); |

queue

- 队列中的数据元素遵循“先进先出”(First In First Out)的原则,简称FIFO结构;

- 在队尾添加元素,在队头删除元素。

1 |

|

deque 双端队列

deque 容器也擅长在序列尾部添加或删除元素(时间复杂度为O(1)),而不擅长在序列中间添加或删除元素。

1 |

|

priority_queue(优先队列)

- 自定义其中数据的优先级, 让优先级高的排在队列前面,优先出队

- 默认利用max-heap(大顶堆)完成对元素的排序,是以vector为表现形式的complete binary tree(完全二叉树)。

- 基本操作和queue一样。

初始化

1 |

|

- Type 就是数据类型,

- Container 就是容器类型(Container必须是用数组实现的容器,比如vector,deque等等,但不能用 list。STL里面默认用的是vector),

- Functional 就是比较的方式,当需要用自定义的数据类型时才需要传入这三个参数,使用基本数据类型时,只需要传入数据类型,默认是大顶堆

排序规则

1 | //降序队列(默认less<>), map/set默认也是使用less,但是是升序序列 |

单链表 (自定义)

一般是题目要求自己实现链表,而不是使用STL提供的链表list。

1 | // 单链表 |

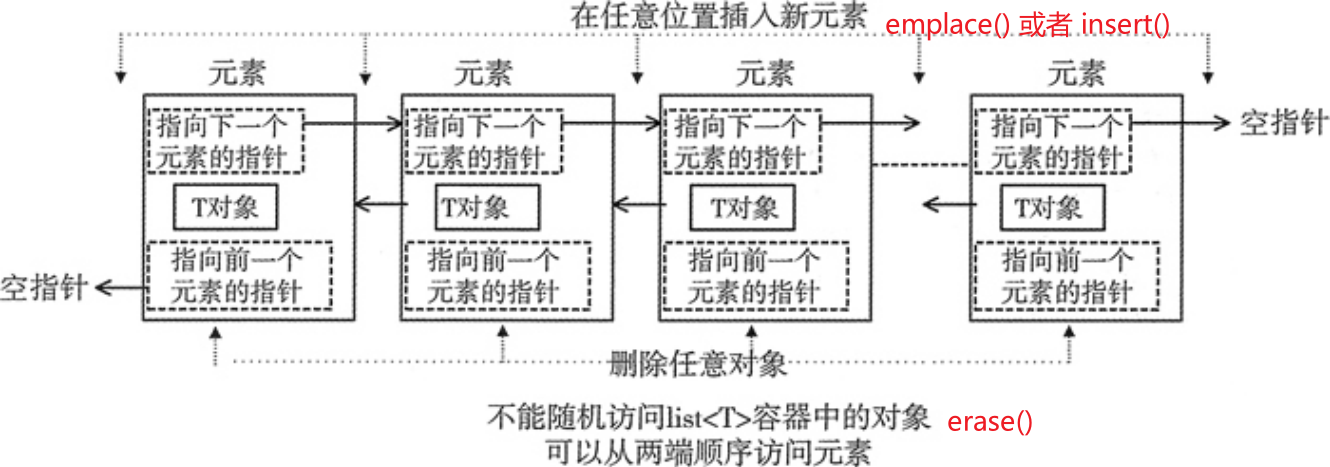

list 双向链表

STL list 容器,又称双向链表容器,即该容器的底层是以双向链表的形式实现的。

- 特点:

- 可以看到,list 容器中各个元素的前后顺序是靠指针来维系的,每个元素都配备了 2 个指针,分别指向它的前一个元素和后一个元素。其中第一个元素的前向指针总为 null,因为它前面没有元素;同样,尾部元素的后向指针也总为 null。

- vector是连续的容器,而list是非连续的容器,即vector将元素存储在连续的存储器中,而list存储在不连续的存储器中。

- 优点: list 容器具有一些其它容器(array、vector 和 deque)所不具备的优势

- 可以在序列已知的任何位置快速插入或删除元素(时间复杂度为O(1))。

- 并且在 list 容器中移动元素,也比其它容器的效率高。

- 缺点

- 不能像 array 和 vector 那样,通过位置直接访问元素。

- 举个例子,如果要访问 list 容器中的第 6 个元素,它不支持容器对象名[6]这种语法格式,

- 也不支持

find()语法,经常使用unorder_map<key, list<xxx>::iterator> listMap保存元素位置来加速查找。- 正确的做法是从容器中第一个元素或最后一个元素开始遍历容器,直到找到该位置。

for (it = list.begin(); it != list.end(); it++) if (it->key == key) break;

- 正确的做法是从容器中第一个元素或最后一个元素开始遍历容器,直到找到该位置。

- 应用场景:需要对序列进行大量添加或删除元素的操作,而直接访问元素的需求却很少,这种情况建议使用 list 容器存储序列。

- 不能像 array 和 vector 那样,通过位置直接访问元素。

1 | //插入 |

数组

1 | int array[2][3] = { |

array

- 与数组同样,array对象的长度也是固定的,

- 分配空间的规则也与数组类似,

- 其效率与数组相同,但更方便,更安全。

1 |

|

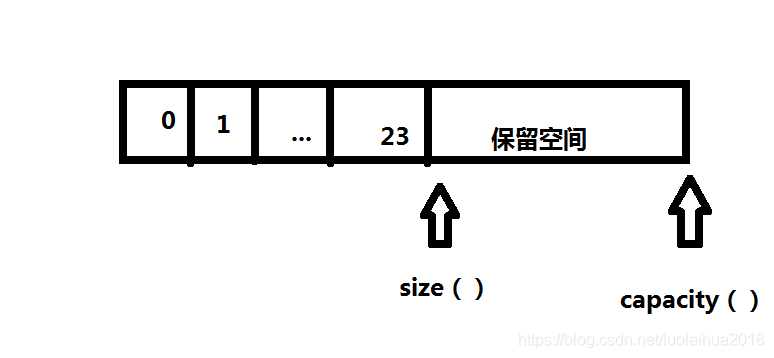

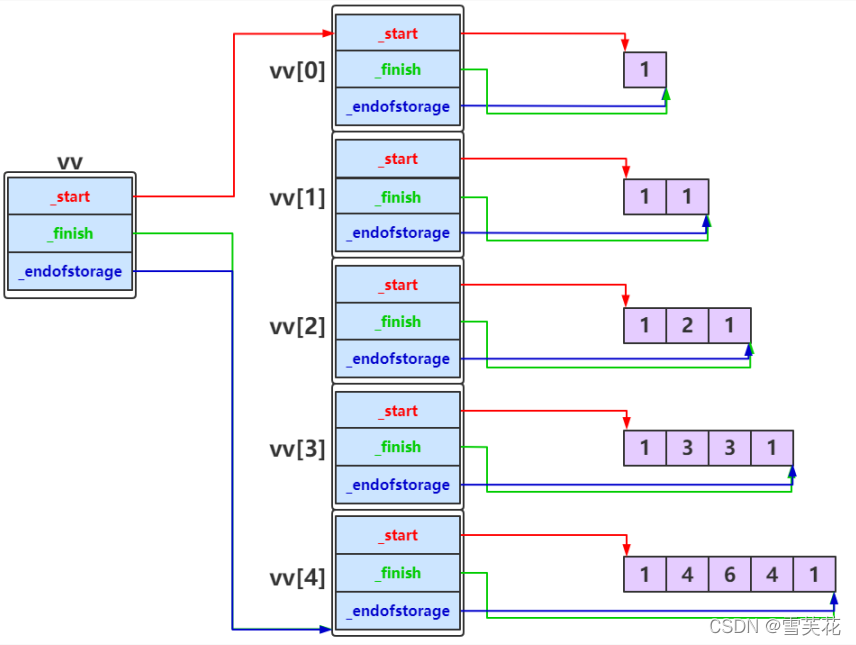

vector

vector是变长的连续存储:

- 对于简单的类型,是直接存储

- 对于复杂的类,存储的是,该元素的信息(比如新构造元素的begin地址,end地址,capacity信息)

初始化

1 | //创建一个vector,元素个数为nSize |

1 | //改变大小,预分配空间,增加 vector 的容量(capacity),但 size 保持不变。 |

增加

vector 也支持中间insert元素,但是性能远差于list。

1 | void push_back(const T& x) //向量尾部增加一个元素X |

删除

1 | iterator erase(iterator it) :删除向量中迭代器指向元素 |

修改

1 | void swap(vector&) :交换两个同类型向量的数据 |

查找

1 | reference at(int pos) :返回pos位置元素的引用 |

其余

返回表示

1 | vector<int> func() { |

hash 哈希

1 |

|

static_cast 用于良性类型转换,一般不会导致意外发生,风险很低。

hash <K> 模板专用的算法取决于实现,但是如果它们遵循 C++14 标准的话,需要满足一些具体的要求。这些要求如下:

- 不能拋出异常

- 对于相等的键必须产生相等的哈希值

- 对于不相等的键产生碰撞的可能性必须最小接近 size_t 最大值的倒数

参考文献

[^1]: How to use unordered_set with custom types?

https://www.runoob.com/w3cnote/cpp-vector-container-analysis.html

【C++容器】数组和vector、array三者区别和联系

https://blog.51cto.com/liangchaoxi/4056308

https://blog.csdn.net/y601500359/article/details/105297918

————————————————

版权声明:本文为CSDN博主「stitching」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。

原文链接:https://blog.csdn.net/qq_40250056/article/details/114681940

————————————————

版权声明:本文为CSDN博主「FishBear_move_on」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。

原文链接:https://blog.csdn.net/haluoluo211/article/details/80877558

————————————————

版权声明:本文为CSDN博主「SOC罗三炮」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。

原文链接:https://blog.csdn.net/luolaihua2018/article/details/109406092

————————————————

版权声明:本文为CSDN博主「鱼思故渊」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。

原文链接:https://blog.csdn.net/yusiguyuan/article/details/40950735

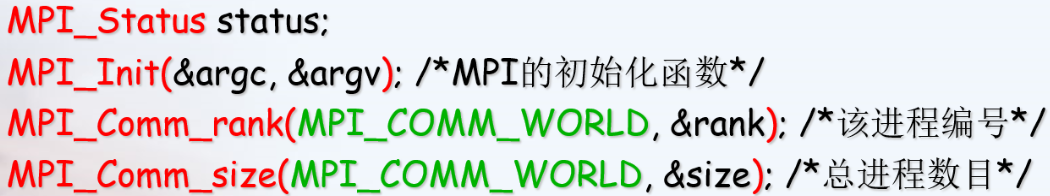

简介

- Message Passing Interface (消息传递接口 MPI) is a standardized and portable message-passing standard designed to function on parallel computing architectures.[1]

- The MPI standard defines the syntax 语法 and semantics 语意 of library routines that are useful to a wide range of users writing portable message-passing programs in C, C++, and Fortran.

- There are several open-source MPI implementations (MPICH,Open MPI), which fostered the development of a parallel software industry, and encouraged development of portable and scalable large-scale parallel applications.

历史

- 1994.6 MPI-1

- 主要的MPI-1模型没有共享内存的概念,

- point-to-point send/recieve, gather/reduce, synchronous, asynchronous,

- MPI-2只有一个有限的分布式共享内存的概念。尽管如此,MPI程序通常在共享内存计算机上运行,MPICH和Open MPI都可以使用共享内存进行消息传输(如果可用的话)。

- 围绕MPI模型(与显式共享内存模型相反)设计程序在NUMA体系结构上运行时具有优势,因为MPI鼓励内存局部性。显式共享内存编程是在MPI-3中引入的。

实现原理简介

虽然MPI属于OSI参考模型的第5层和更高层,但实现可以覆盖大多数层,其中在传输层中使用套接字和传输控制协议(TCP)。

与RDMA的区别

MPI hardware research focuses on implementing MPI directly in hardware, for example via processor-in-memory, building MPI operations into the microcircuitry of the RAM chips in each node. By implication, this approach is independent of language, operating system, and CPU, but cannot be readily updated or removed.

MPI硬件研究的重点是直接在硬件中实现MPI,例如通过内存处理器,将MPI操作构建到每个节点中的RAM芯片的微电路中。通过暗示,这种方法独立于语言、操作系统和CPU,但是不能容易地更新或删除。

Another approach has been to add hardware acceleration to one or more parts of the operation, including hardware processing of MPI queues and using RDMA to directly transfer data between memory and the network interface controller(NIC 网卡) without CPU or OS kernel intervention.

另一种方法是将硬件加速添加到操作的一个或多个部分,包括MPI队列的硬件处理以及使用RDMA在存储器和网络接口控制器之间直接传输数据,而无需CPU或OS内核干预。

与管道的区别

进程间通信都是Inter-process communication(IPC)的一种。常见有如下几种:

- 文件,进程写文件到磁盘,其余进程能并行读取。

- Memory-mapped file 存储在内存里的文件

- signal,多为控制信号

- 信号量(计数器)

- Network Socket

- Message queue 消息队列(没用过

- 管道

- Anonymous pipe 匿名管道(命令行的结果传递

|- 可用于单向进程间通信(IPC)的单FIFO通信通道

- A unidirectional data channel using standard input and output.

- named pipe 有名管道

- 持久化,

mkfifo,具有p的文件属性 - cat tail的例子说明,不建立写读连接会阻塞。

- 持久化,

- Anonymous pipe 匿名管道(命令行的结果传递

- Shared memory 共享内存(OpenMP

- Message passing 消息传递(类似MPI

与OpenMP的关系

线程共享存储器编程模型(如Pthreads和OpenMP)和消息传递编程(MPI/PVM)可以被认为是互补的,并且有时在具有多个大型共享存储器节点的服务器中一起使用。

基本概念

后四个是MPI-2独有的

- Communicator 进程组

- Point-to-point basics 点对点同步异步通信

- Collective basics 集体通信(eg. alltoall

- Derived data types 派生数据类型(自定义传输数据结构

- One-sided communication

- MPI-2定义了三个单边通信操作,分别是对远程存储器的写入、从远程存储器的读取以及跨多个任务对同一存储器的归约操作。

- Dynamic process management 类似进程池?没用过

- 并行文件IO

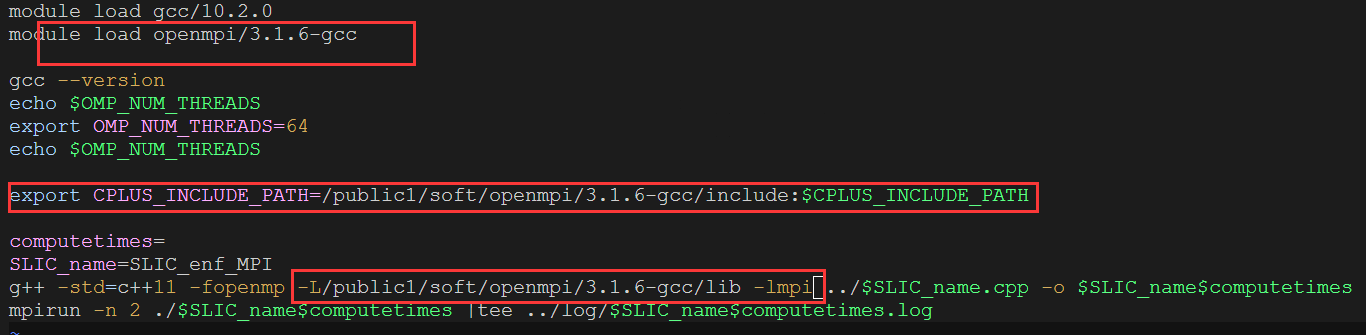

编程

C++ 查看在哪个节点

1 | #include <unistd.h> |

运行命令

输出X个当前机器hostname

mpirun -np 6 -machinefile ./machinelist ./a.out 即可多节点执行。

问题

MPI_Finalize()之后 ,MPI_Init()之前

https://www.open-mpi.org/doc/v4.0/man3/MPI_Init.3.php

不同的进程是怎么处理串行的部分的?都执行(重复执行?)。执行if(rank=num),那岂不是还要同步MPI_Barrier()。

而且写同一个文件怎么办?

对等模式和主从模式

MPI的两种最基本的并行程序设计模式 即对等模式和主从模式。

对等模式:各个部分地位相同,功能和代码基本一致,只不过是处理的数据或对象不同,也容易用同样的程序来实现。

主从模式:分为主进程和从进程,程序通信进程之间的一种主从或依赖关系 。MPI程序包括两套代码,主进程运行其中一套代码,从进程运行另一套代码。

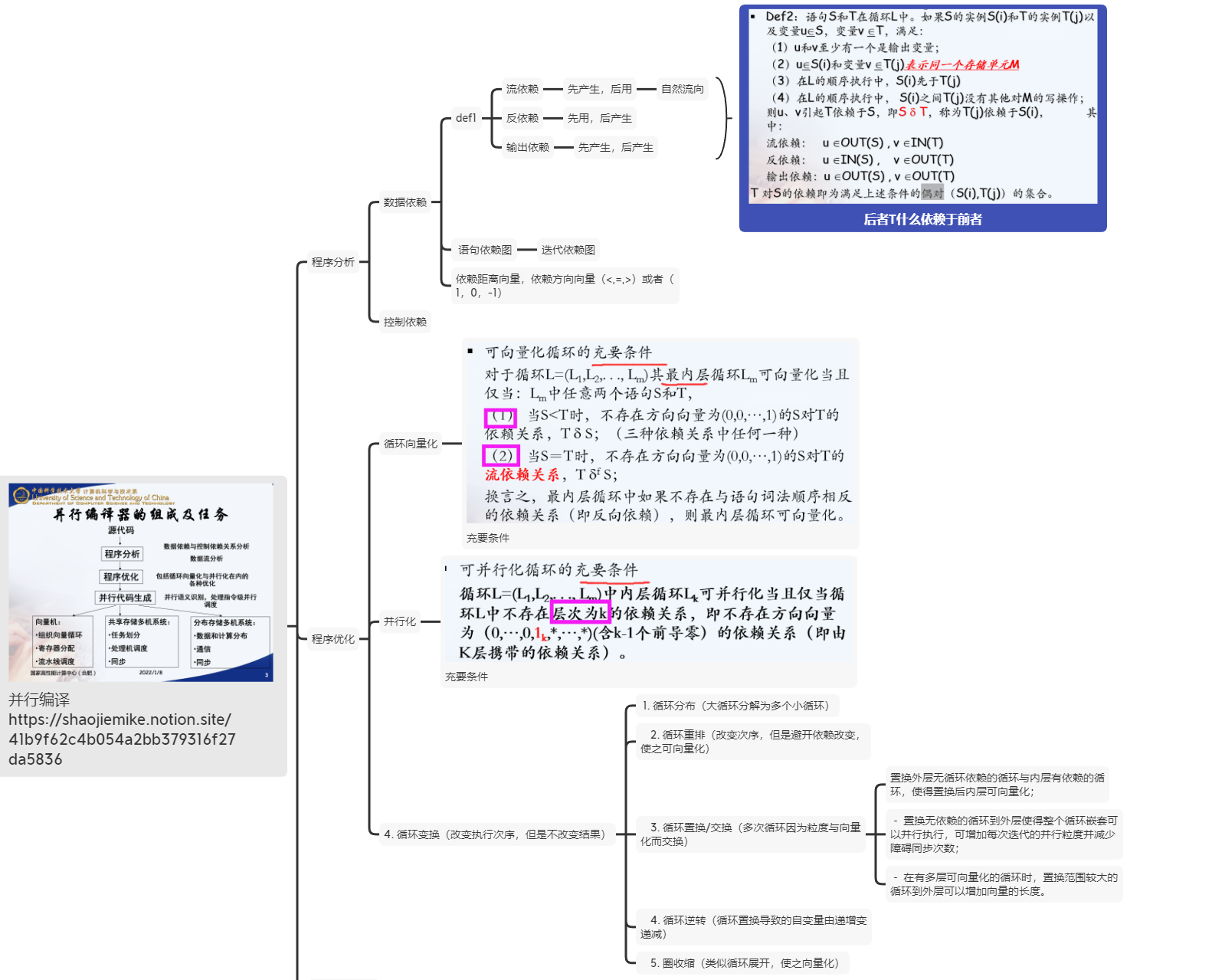

程序并行可行性分析

圈收缩(cycle shrinking)-此变换技术一般用于依赖距离大于1的循环中,它将一个串行循环分成两个紧嵌套循环,其中外层依然串行执行,而内层则是并行执行(一般粒度较小)

https://shaojiemike.notion.site/41b9f62c4b054a2bb379316f27da5836

MPI消息

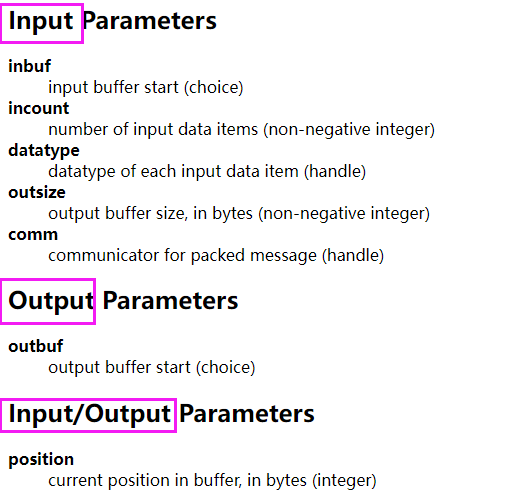

预定义类型消息——特殊MPI_PACKED

MPI_PACKED预定义数据类型被用来实现传输地址空间不连续的数据项 。

1 | int MPI_Pack(const void *inbuf, |

The input value of position is the first location in the output buffer to be used for packing. position is incremented by the size of the packed message,

and the output value of position is the first location in the output buffer following the locations occupied by the packed message. The comm argument is the communicator that will be subsequently used for sending the packed message.

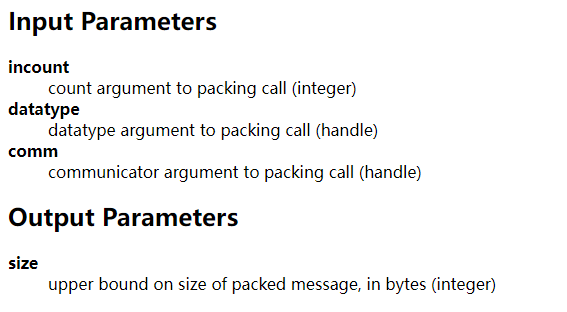

1 | //Returns the upper bound on the amount of space needed to pack a message |

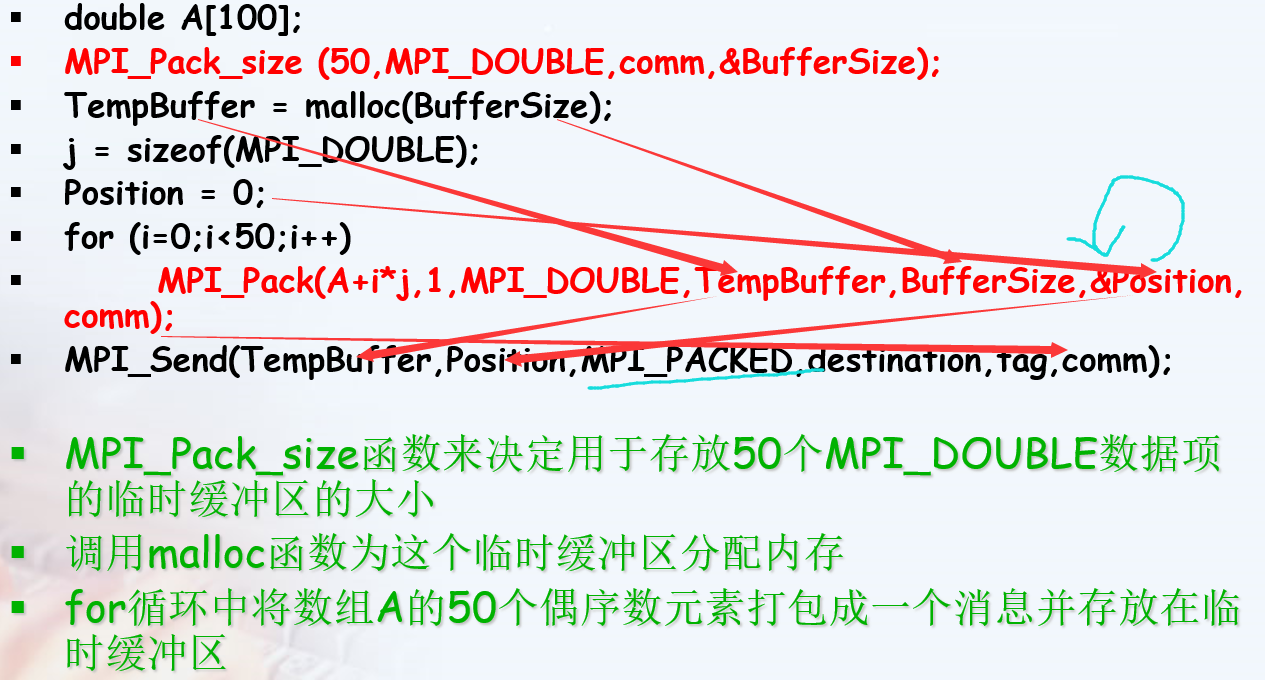

例子:

这里的A+i*j应该写成A+i*2吧???

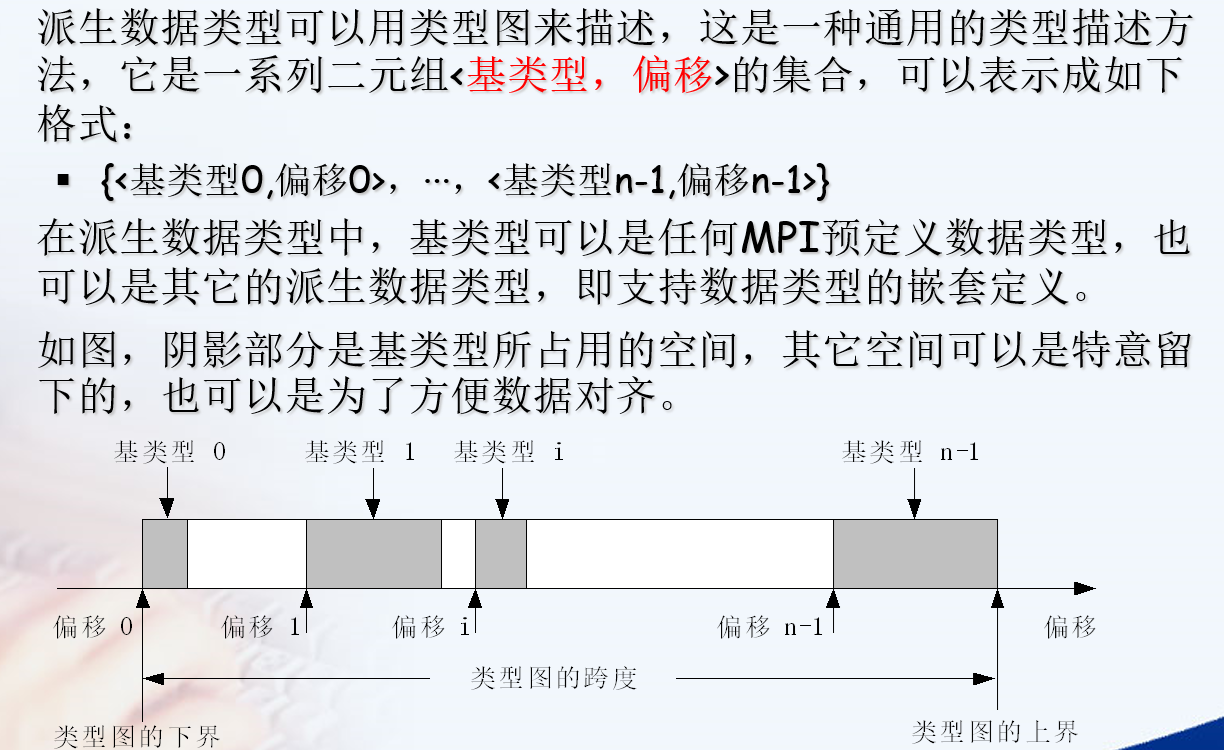

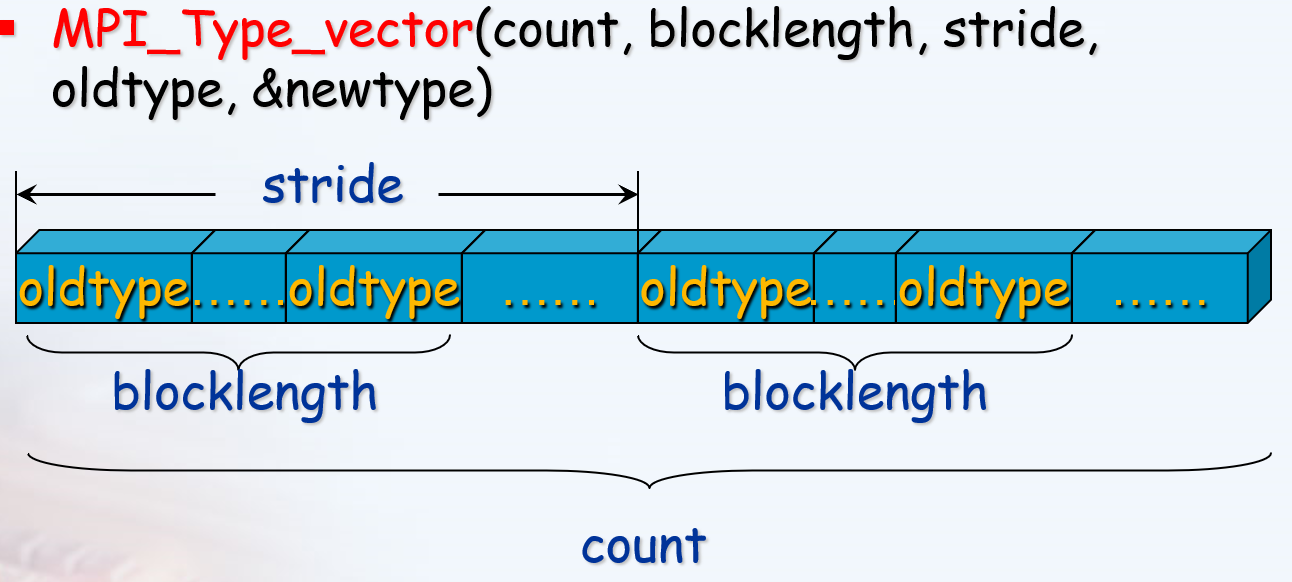

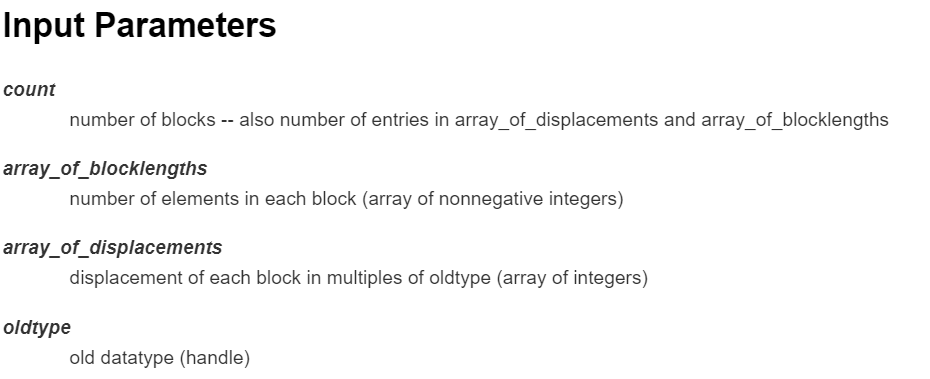

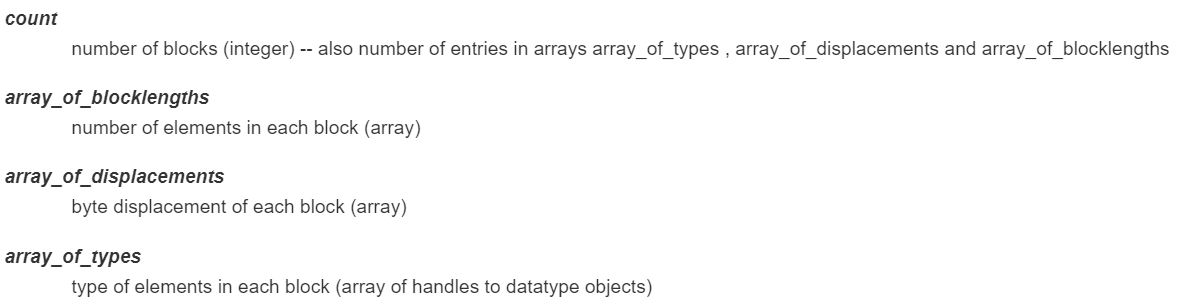

派生数据类型(Derived Data Type)

来定义由数据类型不同且地址空间不连续的数据项组成的消息。

1 | //启用与弃用数据类型 |

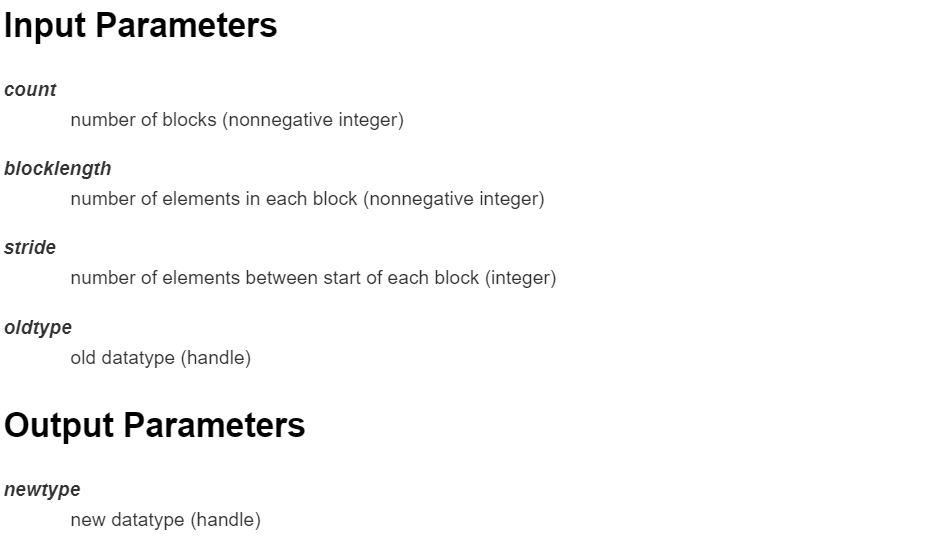

1 | //成块的相同元素组成的类型,块长度和偏移由参数指定 |

1 | //由不同数据类型的元素组成的类型, 块长度和偏移(肯定也不一样)由参数指定 |

通讯域映射为网格表示

MPI_Cart_create

确定了虚拟网络每一维度的大小后,需要为这种拓扑建立通信域。组函数MPI_Cart_create可以完成此任务,其声明如下:

1 | // Makes a new communicator to which topology拓扑 information has been attached |

通信域划分

1 | int MPI_Comm_create(MPI_Comm comm, MPI_Group group, MPI_Comm * newcomm) |

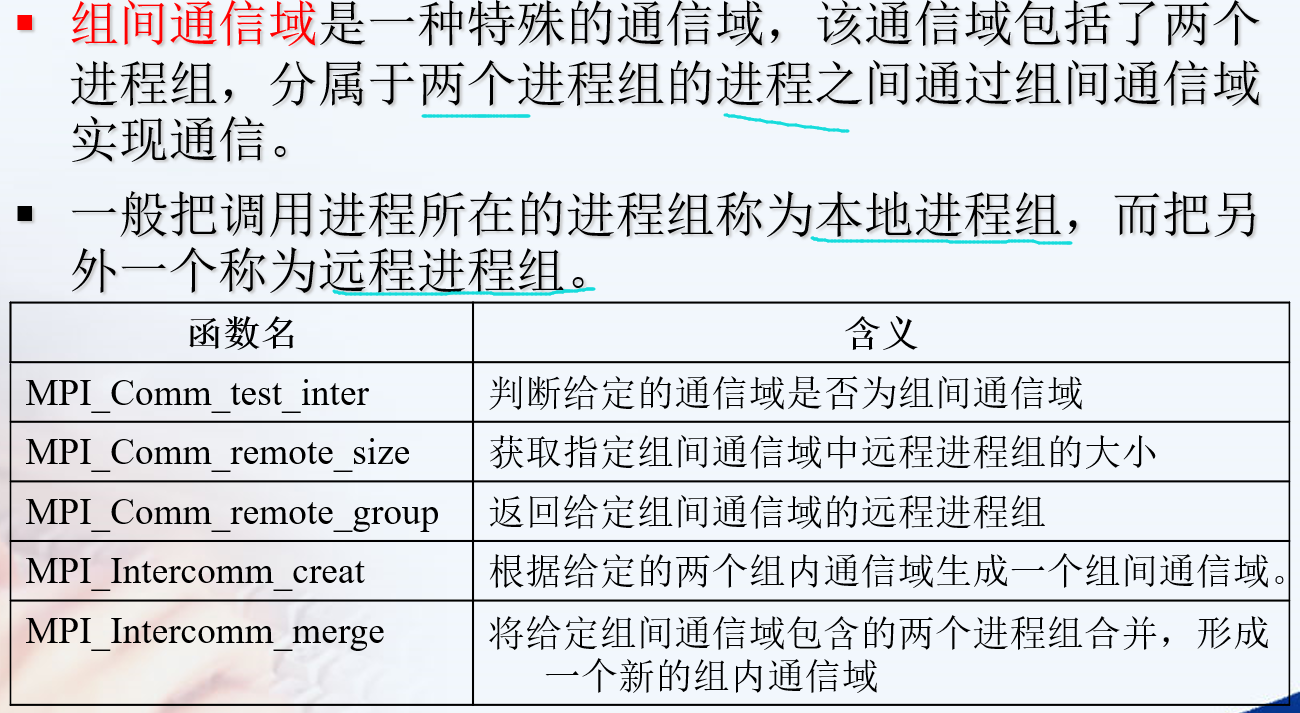

组间通信域

点对点通信

特殊的函数

1 | int MPI_Sendrecv(const void *sendbuf, int sendcount, MPI_Datatype sendtype, |

特别适用于在进程链(环)中进行“移位”操作,而避免在通讯为阻塞方式时出现死锁。

There is also another error. The MPI standard requires that the send and the receive buffers be disjoint不相交 (i.e. they should not overlap重叠), which is not the case with your code. Your send and receive buffers not only overlap but they are one and the same buffer. If you want to perform the swap in the same buffer, MPI provides the MPI_Sendrecv_replace operation.

1 | //MPI标准阻塞通信函数,没发出去就不会结束该命令。 |

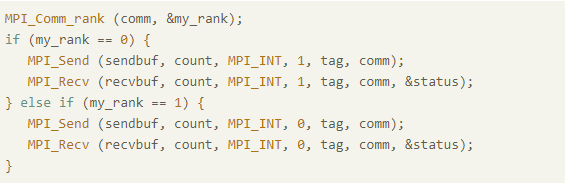

是否会导致死锁

可能大家会想到这会死锁,如下图:

但是实际情况可能并不会死锁,这与调用的MPI库的底层实现有关。

MPI_Send将阻塞,直到发送方可以重用发送方缓冲区为止。当缓冲区已发送到较低的通信层时,某些实现将返回给调用方。当另一端有匹配的MPI_Recv()时,其他一些将返回到呼叫者。

但是为了避免这种情况,可以调换Send与Recv的顺序,或者**使用MPI_Isend()或MPI_Issend()**代替非阻塞发送,从而避免死锁。

梯形积分

1 | /* |

群集通讯

一个进程组中的所有进程都参加的全局通信操作。

实现三个功能:通信、聚集和同步。

- 通信功能主要完成组内数据的传输

- 聚集功能在通信的基础上对给定的数据完成一定的操作

- 同步功能实现组内所有进程在执行进度上取得一致

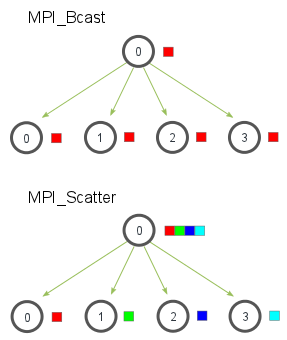

常见的通讯

1 | //将一个进程中得数据发送到所有进程中的广播函数 |

注意data_p在root 或者scr_process进程里是发送缓存也是接收缓存,但是在其余进程里是接收缓存。

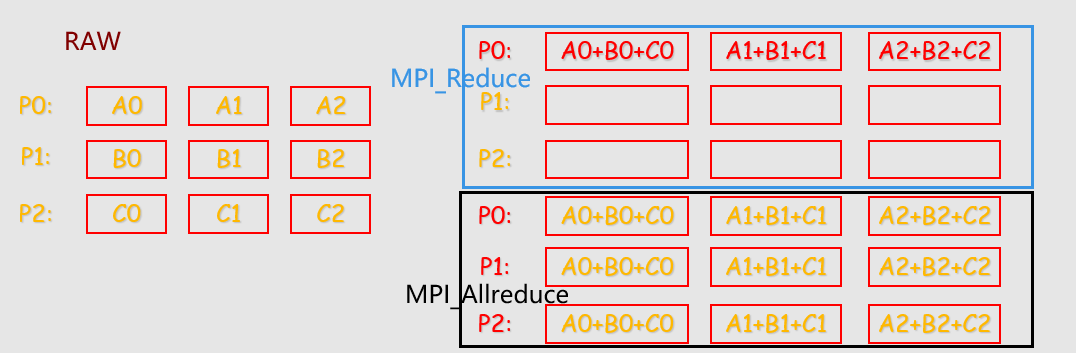

MPI_Scatter?

区别

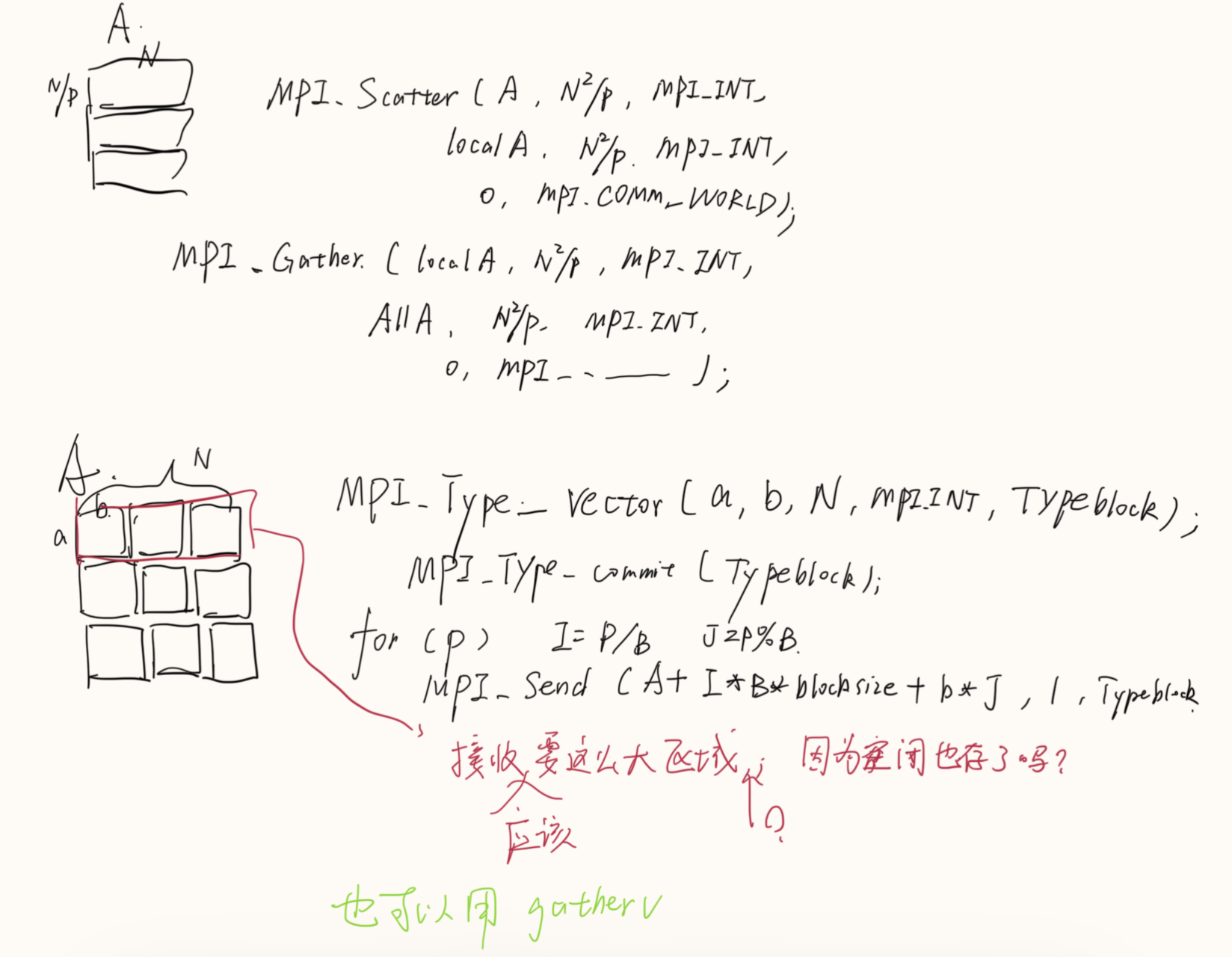

- MPI_Scatter与MPI_Bcast非常相似,都是一对多的通信方式,不同的是后者的0号进程将相同的信息发送给所有的进程,而前者则是将一段array的不同部分发送给所有的进程,其区别可以用下图概括:

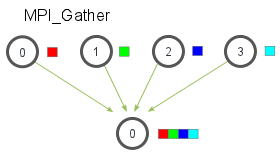

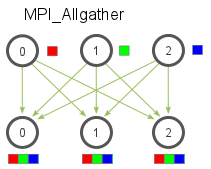

- MPI_Gather,作用是从所有的进程中将每个进程的数据集中到根进程中,同样根据进程的编号对array元素排序,

- 接收缓冲由三元组<RecvAddress, RecvCount, RecvDatatype>标识,发送缓冲由三元组<SendAddress, SendCount, SendDatatype>标识,所有非Root进程忽略接收缓冲。

- MPI_Allgather 当数据分布在所有的进程中时,MPI_Allgather将所有的数据聚合到每个进程中。

- Allgather操作相当于每个进程都作为ROOT进程执行了一次Gather调用,即每一个进程都按照Gather的方式收集来自所有进程(包括自己)的数据。

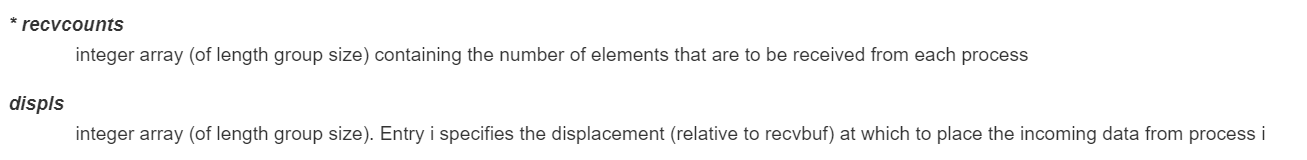

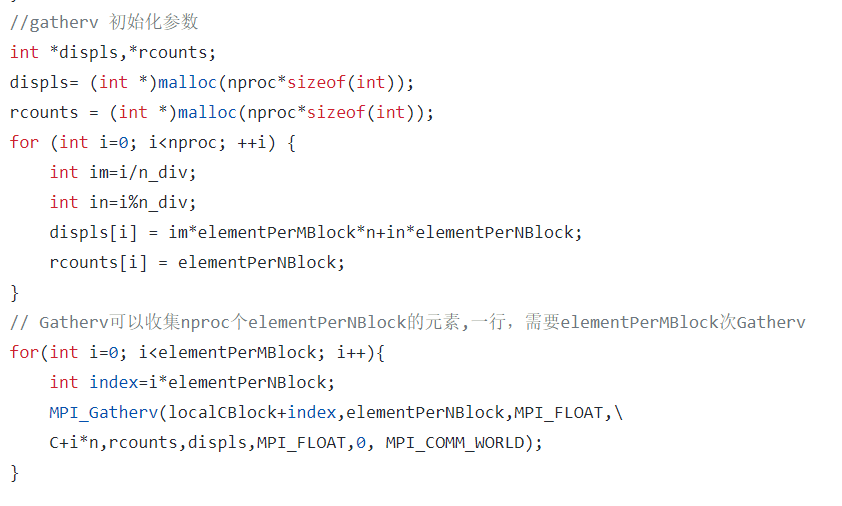

- MPI_GATHERV扩展了功能,提供新的参数disp,是一个整数数组,包含存放从每个进程接收的数据相对于recvbuf的偏移地址

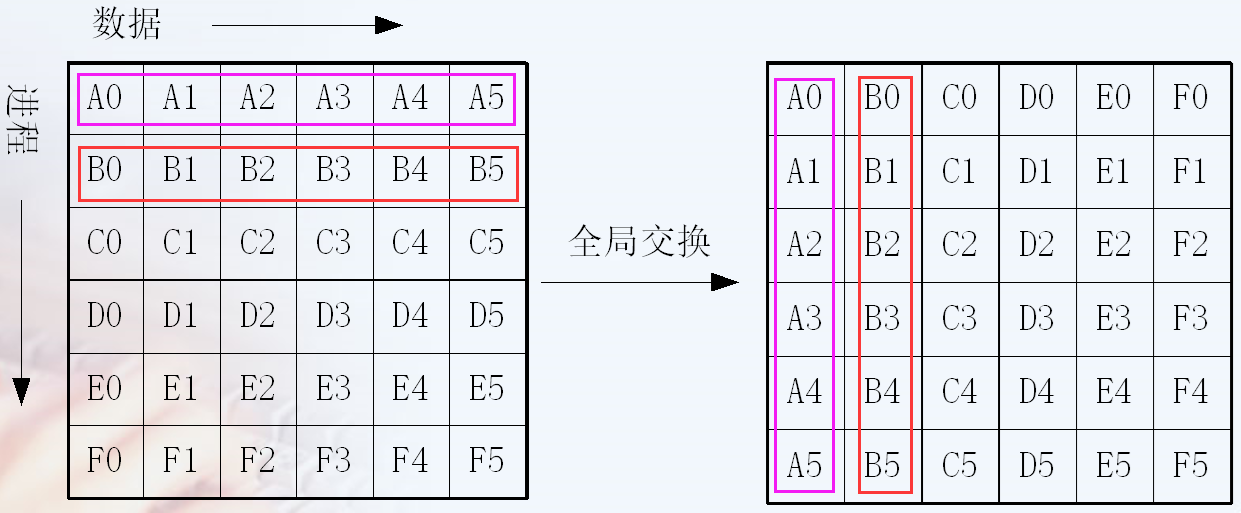

- MPI_alltoall()

- 等价于每个进程作为Root进程执行了一次MPI_Scatter散播操作。recvcount gather和allgather是一样的

1

2

3

4

5

6int MPI_Allgather(void * sendbuff, int sendcount, MPI_Datatype sendtype,

void * recvbuf, int recvcount, MPI_Datatype recvtype,

MPI_Comm comm)

int MPI_Allgatherv(void * sendbuff, int sendcount, MPI_Datatype sendtype,

void * recvbuf, int * recvcounts, int * displs,

MPI_Datatype recvtype, MPI_Comm comm)

number of elements received from any process (integer)

注意

- 通信域中的所有进程必须调用群集通信函数。如果只有通信域中的一部分成员调用了群集通信函数而其它没有调用,则是错误的。

- 除MPI_Barrier以外,每个群集通信函数使用类似于点对点通信中的标准、阻塞的通信模式。也就是说,一个进程一旦结束了它所参与的群集操作就从群集函数中返回,但是并不保证其它进程执行该群集函数已经完成。

- 一个群集通信操作是不是同步操作取决于实现。MPI要求用户负责保证他的代码无论实现是否同步都必须是正确的。 ???与后面矛盾了 mpich官网说明的。

- 关于同步最后一个要注意的地方是:始终记得每一个你调用的集体通信方法都是同步的。

- 在MPI-3.0之前MPI中的所有集合操作都是阻塞的,这意味着在返回之后使用传递给它们的所有缓冲区是安全的.特别是,这意味着当其中一个函数返回时,会收到所有数据.(但是,它并不意味着所有数据都已发送!)因此,如果所有缓冲区都已有效,则在集合操作之前/之后MPI_Barrier不是必需的(或非常有用).

- 对用户的建议:为保证程序正确性而依赖于集合操作中同步的副作用是很危险的作法.例如,即便一个特定的实现策略可以提供一个带有同步副作用的广播通信例程, 但标准却不支持它,因此依赖于此副作用的程序将不可移植.从另一方面讲,一个正确的、可移植的程序必须能容忍集合操作可能带来同步这样 一个事实.尽管一个程序可以丝毫不依赖于这种同步的副作用,编程时也必须这样做.这个问题在4.12节中还将进一步讨论(对用户的建议结尾) https://scc.ustc.edu.cn/zlsc/cxyy/200910/MPICH/mpi41.htm

- 关于不同的进程运行同一句Bcast的效果

- 当根节点(在我们的例子是节点0)调用 MPI_Bcast 函数的时候,data 变量里的值会被发送到其他的节点上。当其他的节点调用 MPI_Bcast 的时候,data 变量会被赋值成从根节点接受到的数据。

- 所以如果有进程无法到达该语句Bcast,同步的性质会导致到达Bcast的命令需要等待。

聚合

MPI聚合的功能分三步实现

- 首先是通信的功能,即消息根据要求发送到目标进程,目标进程也已经收到了各自需要的消息;

- 然后是对消息的处理,即执行计算功能;

- 最后把处理结果放入指定的接收缓冲区。

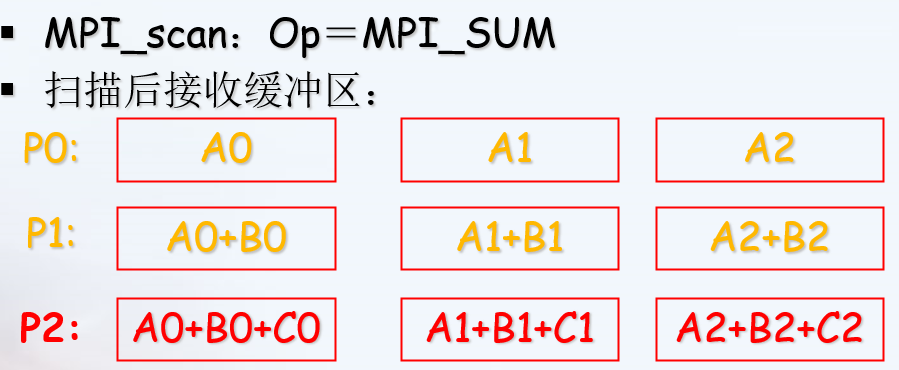

MPI提供了两种类型的聚合操作: 归约和扫描。

聚合——归约

1 | int MPI_Reduce( |

自定义归约操作

1 | int MPI_Op_create(MPI_User_function *function, int commute, MPI_Op *op) |

用户自定义函数 functiontypedef void MPI_User_function(void *invec, void *inoutvec, int *len, MPI_Datatype *datatype)

1 | for(i=0;i<*len;i++) { |

必须具备四个参数:

- invec 和 inoutvec 分别指出将要被归约的数据所在的缓冲区的首地址,

- len指出将要归约的元素的个数, datatype 指出归约对象的数据类型

也可以认为invec和inoutvec 是函数中长度为len的数组, 归约的结果重写了inoutvec 的值。

梯形积分(MPI_Reduce)

1 | /* |

注意事项

- 除了#include “mpi.h”

需要进一步的研究学习

MPI_Group https://www.rookiehpc.com/mpi/docs/mpi_group.php

并行IO文件

1997年推出了MPI的最新版本MPI-2

MPI-2加入了许多新特性,主要包括

- 动态进程(Dynamic Process)

- 远程存储访问(Remote Memory Access)

- 并行I/O访问(Parallel I/O Access)

- MPI-1没有对并行文件I/O给出任何定义,原因在于并行I/O过于复杂,很难找到一个统一的标准。

more

- MPI-1没有对并行文件I/O给出任何定义,原因在于并行I/O过于复杂,很难找到一个统一的标准。

遇到的问题

数据发送和收集

开题缘由、总结、反思、吐槽~~

参考文献

https://blog.csdn.net/susan_wang1/article/details/50033823

https://blog.csdn.net/u012417189/article/details/25798705

是否死锁: https://stackoverflow.com/questions/20448283/deadlock-with-mpi

https://mpitutorial.com/tutorials/

http://staff.ustc.edu.cn/~qlzheng/pp11/ 第5讲写得特别详细

VPN原理

vpn:英文全称是“Virtual Private Network”,翻译过来就是“虚拟专用网络”。vpn通常拿来做2个事情:

- 一个是可以让世界上任意2台机器进入一个虚拟的局域网中(当然这个局域网的数据通讯是加密的,很安全,用起来和一个家庭局域网没有区别),

- 一个是可以用来翻墙。

VPN与SS的区别

- SS全称shadowsocks,SSR全称shadowsocks-R

- VPN是为了保证通信的安全性、私密性,不是专门为“科学上网”制定的技术

- 而SS/SSR则是为了转发客户端流量,绕过防火墙的检测,从而达到“科学上网”的真实意图,但是没有保证数据传输的安全性。

- vpn比ss更加底层,它通过操作系统的接口直接虚拟出一张网卡,后续整个操作系统的网络通讯都将通过这张虚拟的网卡进行收发。

- 这和任何一个代理的实现思路都差不多,应用层并不知道网卡是虚拟的,这样vpn虚拟网卡将以中间人的身份对数据进行加工,从而实现各种神奇的效果。具体来说,vpn是通过编写一套网卡驱动并注册到操作系统实现的虚拟网卡,这样数据只要经过网卡收发就可以进行拦截处理。

一句话,vpn在IP层工作,而ss在TCP层工作。

内网访问举例

- 普通用户无法访问公司内网服务器

- 开启VPN以后,如果他想打开公司ERP,他的电脑就不再直接连接公司ERP网站,而是去连接VPN服务器,并给VPN服务器发一条指令——“我要访问公司ERP”。

- VPN服务器接到指令后,VPN服务器自己去访问公司ERP,收到公司ERP网页的内容,再把内容回传给员工,这样使用VPN的员工最终就能看到公司ERP网站的内容了。

- 也就是说,使用VPN时,这个员工的所有网上访问都通过VPN服务器代理完成的。

IP packet 如何被传输

理解 VPN 路由(以及任何网络路由)配置的关键是认识到一个 IP packet 如何被传输,以下描述的是极度简化后的单向传输过程:

- 机器 A (192.168.0.2) 发送了一个目标地址为 172.29.1.4 的 IP packet.

- 根据本地路由规则,172.29.1.0/24 的下一跳是虚拟网卡 tun0, 由 VPN 客户端接管。

- VPN 客户端将这个 packet 的来源地址从 192.168.0.2 改为 10.8.0.123, 转发给 VPN 服务端。

- VPN 服务端收到 packet. 根据本地路由规则,172.29.1.0/24 的下一跳是默认网关 172.29.1.1.

- 默认网关找到在同一个局域网内的机器 B (172.29.1.4).

客户端 -> 内网

为什么机器 A 的本地路由表里会有 172.29.1.0/24 这个网段的路由规则?通常情况下,这是 OpenVPN 服务端推送给客户端,由客户端在建立 VPN 连接时自动添加的。也可以由服务端自定义,比如wireguard

内网 -> 客户端

这个时候,如果机器 B 想要回复 A(比如发个 ACK),就会出问题,因为 packet 的来源地址还是 10.8.0.123, 而 10.8.0.0/24 网段并不属于当前局域网,是 VPN 服务端私有的——机器 B 往 10.8.0.123 发送的 ACK 会在某个位置(比如默认网关)遇到 “host unreachable” 而被丢弃。对于机器 A 来说,表面现象可能是连接超时或 ping 不通。

解决方法是,在 packet 离开 VPN 服务端时,将其「伪装」成来自 172.29.0.3(举例VPN 服务端的局域网地址),这样机器 B 发送的 ACK 就能顺利回到 VPN 服务端,然后发给机器 A. 这就是所谓的 SNAT。

- SNAT: Source Network Address Translation,是修改网络包源ip地址的。

- DNAT: Destination Network Address Translation,是修改网络包目的ip地址的。

在 Linux 系统中由 iptables 来管理,具体命令是:

1 | iptables -t nat -A POSTROUTING -s 10.8.0.0/24 -o eth0 -j MASQUERADE. |

客户端 -> 另一个客户端的内网

连接 OpenVPN 的两个 client 之间可以互相通信,这是因为服务端推送的路由里包含了对应的网段。但是想从 Client A 到达 Client B 所在局域网的其他机器,还需要额外的配置。因为 OpenVPN 服务端缺少 Client B 局域网相关的路由规则。

1 | server.conf |

内网与内网互访

在前两节所给的配置基础上,只需要再加一点配置,就能实现 OpenVPN 服务端所在局域网与客户端所在局域网的互访。配置内容是,在各自局域网的默认网关上添加路由,将对方局域网网段的下一跳设为 OpenVPN 服务端 / 客户端所在机器,同时用 iptables 配置相应的 SNAT 规则。

机场购买链接推荐

Based on the info in clashio, we select some cheap vpns to try.

| name | 每月价格(¥/GB/off on holiday) | 每月单价(GB/¥) | 每年单价(GB/¥) | 节点数与稳定性 | 使用速度感觉 |

|---|---|---|---|---|---|

| fastlink 2019 | 20/100/-30% | 5 | 100+, 节点速度高达5Gbps | 峰值 5Gbps (1) | |

| totoro 2023 | 15/100/-20%(2) | 6.6 | ??? | ??? | |

| 冲浪猫 2022 | 16/200/-12%(3) | 12.5 | ??? | 峰值 1Gbps | |

| 奈云机场 2021 | 10.6/168/-30%(4) | 15.8 | 230624购买,240109几天全面掉线 | 峰值 5Gbps (6) | |

| FatCat 2023 | 6/60/-20% | 10 | ??? | 峰值 xx Gbps |

!!! question annotate “My Choice: 单价,大小,速度,优惠码有效期”

1. 优惠码(春节 中秋 双十一)

1. [fastlink](https://v02.fl-aff.com/auth/register?code=rotu) 用了两年了,还是x3很快的。但是相当于一个月只有30GB, 不够用。

3. [奈云机场](https://www.naiun2.top/#/register?code=gL7mHyh9)(可靠性暂时不行),[冲浪猫](https://b.msclm.net/#/register?code=AAUF1Efg) 平衡比较好。

现在组合:奈云机场(2) + fastlink。 等fastlink过期了(1),看要不要转成 冲浪猫。

- 240624

- 241105 配置:复制订阅,订阅地址后面加

&flag=clash下载config.yaml

SJF 稳定翻墙VPS

brook vpn+ Amazon American node

各种设备翻墙

参考文献

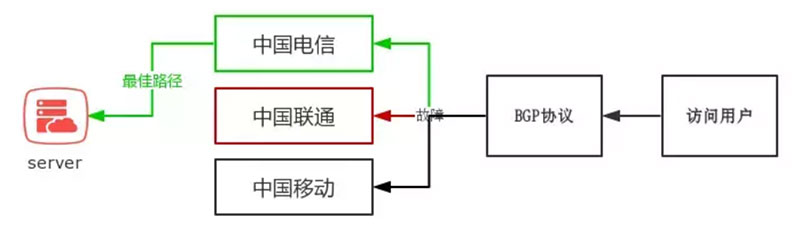

[^1]: BGP 漫谈

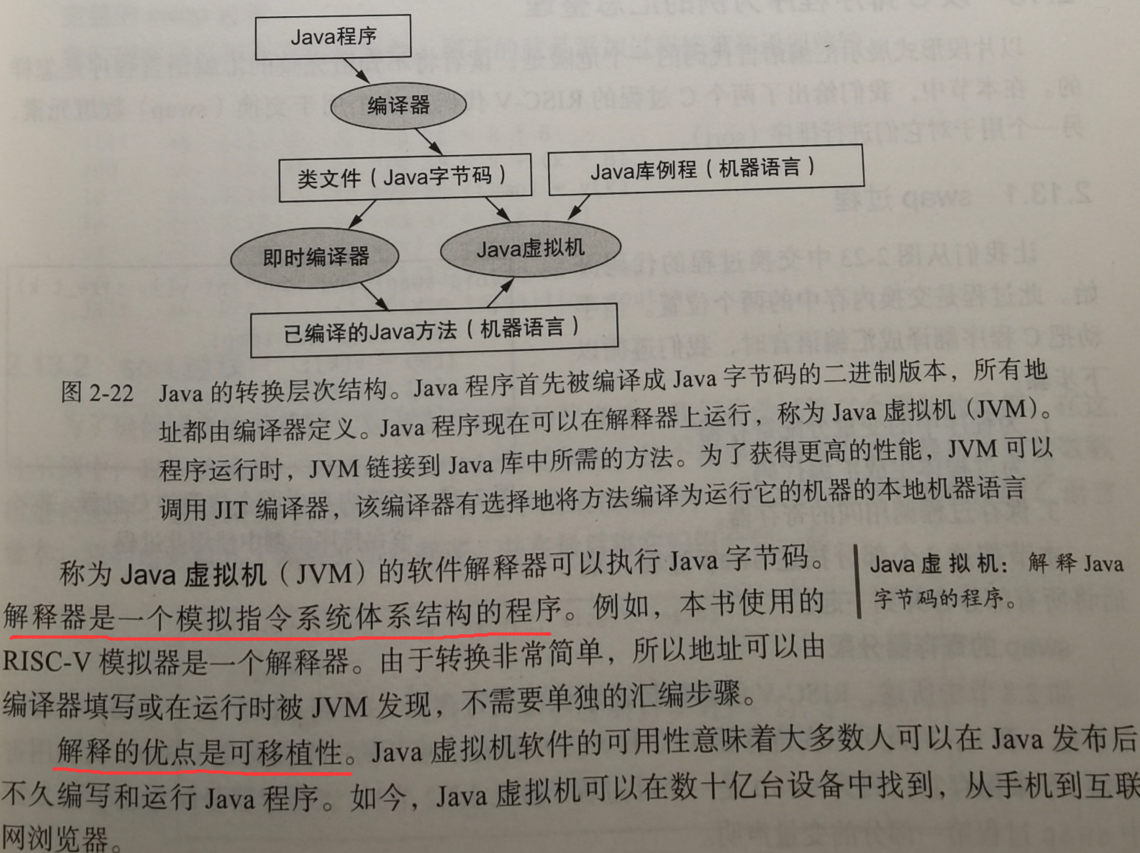

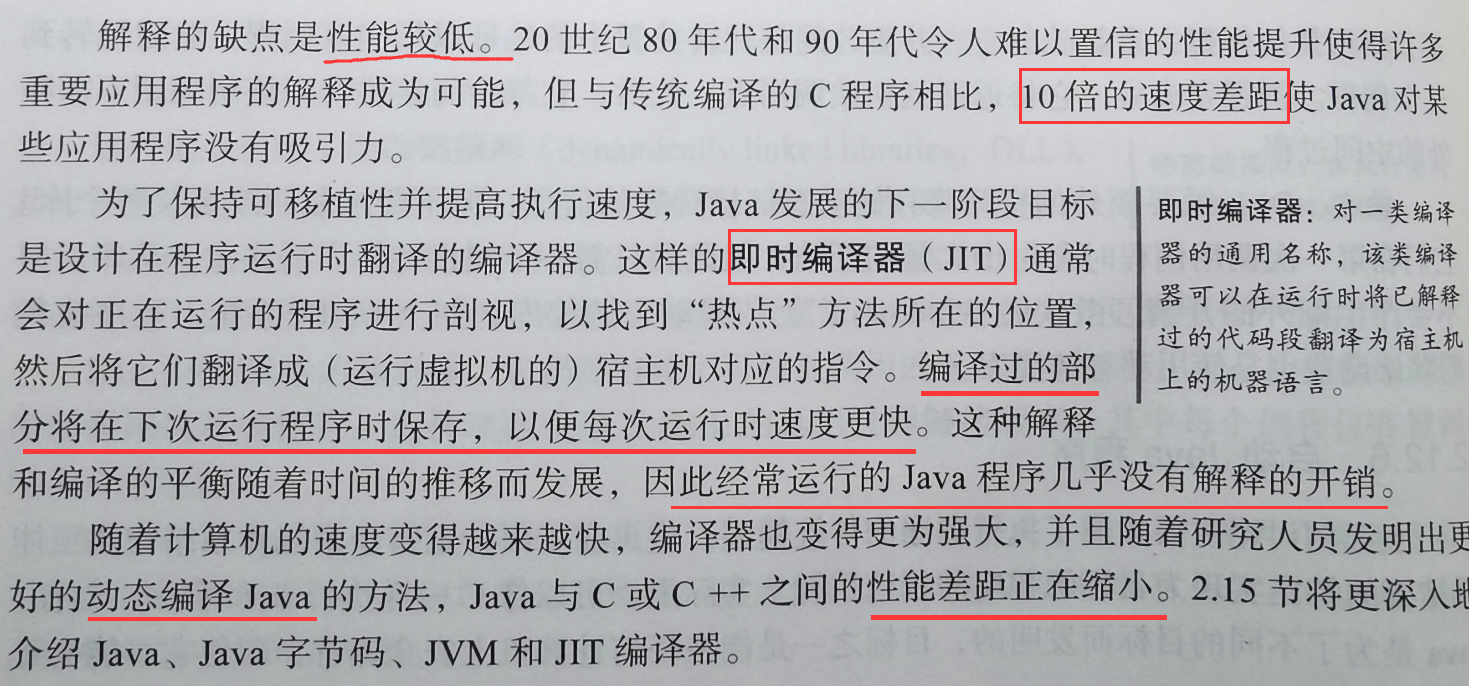

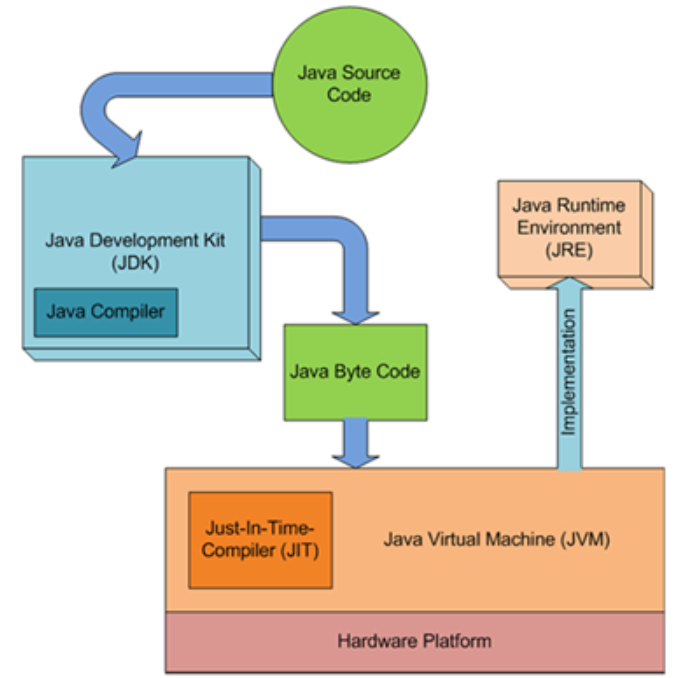

java运行的特点

JVM(java虚拟机)

Just-In-Time (JIT) 编译器

- JIT编译器是一种动态编译技术,它将程序的一部分或者全部源代码或更常见的字节码在运行时编译成机器码,然后将编译后的代码替换原来的代码。

- 字节码(英语:Bytecode)通常指的是已经经过编译,但与特定机器代码无关,需要解释器转译后才能成为机器代码的中间代码(多为虚拟机代码)。典型应用为Java虚拟机里的Java bytecode。

- 主要优点是可以在运行时根据程序的运行情况进行优化,从而提高程序的执行效率。

- 字节码编译是跨平台的,便于移植的。

- 主要缺点是编译字节码导致的延迟和空间开销较大,因此只有在程序运行时间较长的情况下才能体现出优势。

- 是提前编译(AOT)和字节码解释器(python的实现)的结合体,它的执行效率介于两者之间。

区别

- Java Virtual Machine (JVM) is an abstract computing machine.

- Java Runtime Environment (JRE) is an implementation of the JVM.

- Java Development Kit (JDK) contains JRE along with various development tools like Java libraries, Java source compilers, Java debuggers, bundling and deployment tools.

- Java SE: Java™ Platform Standard Edition 21 Development Kit - JDK™ 21

- Just In Time compiler (JIT) is runs after the program has started executing, on the fly. It has access to runtime information and makes optimizations of the code for better performance.

Install

Intall for topcoder

- download from website

- But the first download choice

java 21 SDKseems not contain Java Control Panel (javacpl.exe), you need to install Java SE Development Kit 8u381 which includeJDK 1.8andJRE 1.8

- But the first download choice

- config Java Control Panel, add

https://www.topcoder.comto allowed website (Attention: https) - open

ContestAppletProd.jnlp - need

127.0.0.1proxy andHTTP TUNE 1to connect to server

需要进一步的研究学习

暂无

遇到的问题

暂无

开题缘由、总结、反思、吐槽~~

参考文献

无Disk C: make room for installation

C 盘没空间了,啊啊啊~